Bot de IA vs. Googlebots: Estrategias de indexación para plataformas generativas

Identifica cómo funciona cada bot de IA, en qué se diferencia de Googlebot y qué estrategias técnicas necesitas para ser visible en plataformas generativas.

En el entorno digital, el bot de IA es un componente fundamental para que los motores de búsqueda y las plataformas generativas descubran contenido para el usuario. Aunque Googlebot ha sido históricamente el líder en este ámbito, actualmente actores emergentes están ganando una fuerte presencia, consolidándose como referentes en el ecosistema de rastreo.

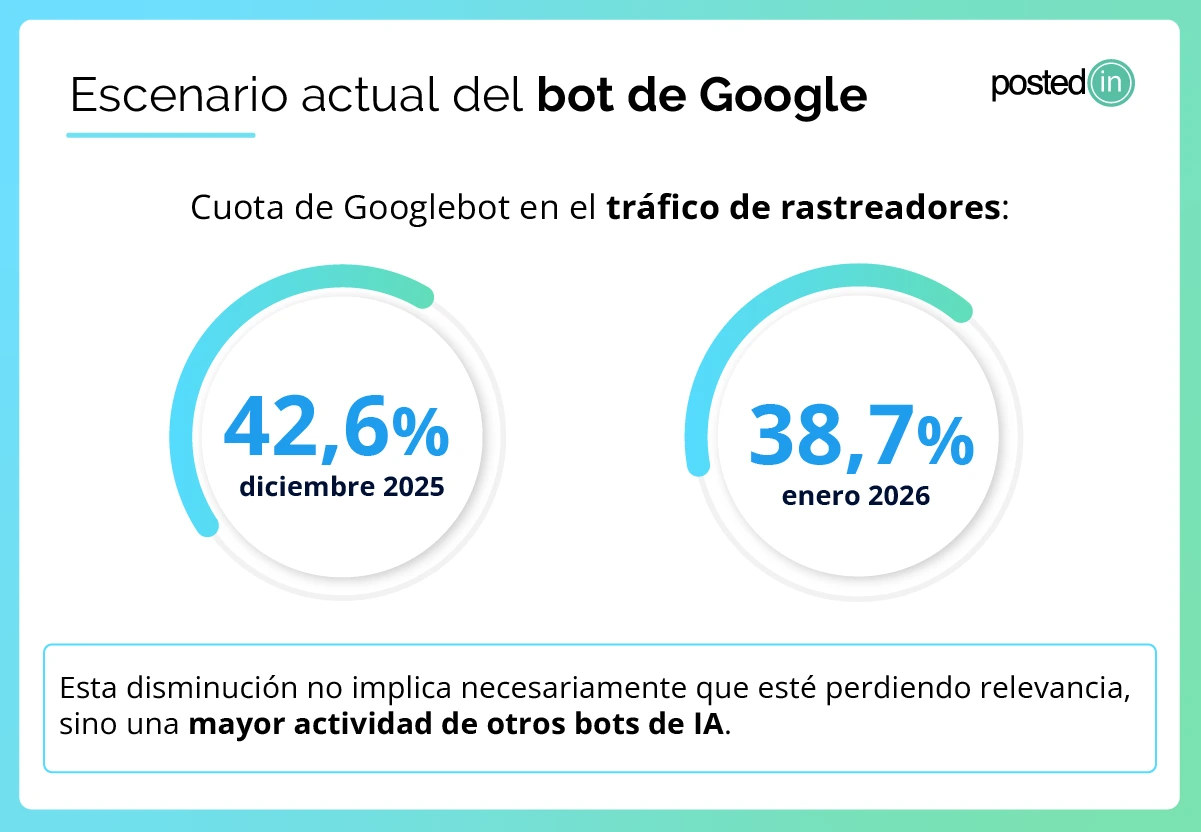

De hecho, según datos de Cloudflare Radar, la cuota en el tráfico de rastreadores de IA de Googlebot pasó del 42,6 % en diciembre de 2025 al 38,7 % en enero de 2026, no porque haya perdido relevancia, sino porque otros bots están aumentando su volumen de rastreo.¹

Por eso, los líderes de marketing digital no solo deben optimizar para bots tradicionales, sino que también deben considerar los de IA, que operan con lógicas técnicas y propósitos distintos.

¿Qué es un bot de IA y en qué se diferencia de Googlebot?

Un bot de IA es un agente automatizado que rastrea, indexa o accede a contenido web con el objetivo de entrenar modelos de lenguaje, alimentar sistemas de recuperación o responder consultas en interfaces conversacionales. Entre los más destacados se encuentran GPTbot, Claudebot y Amazonbot.

A diferencia de Googlebot, que es el rastreador tradicional para motores de búsqueda con IA, el propósito central del bot de IA puro no es el posicionamiento en resultados de búsqueda tradicionales, sino la síntesis y recuperación de información para outputs generativos. Estas diferencias de propósito se traducen en comportamientos técnicos distintos a la hora de rastrear e interpretar contenido.

¿Cómo leen el contenido web los bots de IA?

Para que un modelo recupere o sintetice contenido en interfaces generativas, primero necesita localizarlo y procesarlo. Ese flujo se divide en dos etapas: crawling e indexación para IA. Por ejemplo, en el caso de GPTbot, el proceso funciona así:

Rastreo (Crawling): GPTBot descubre URLs a partir de backlinks, enlaces en consultas de usuarios y referencias a sitemap.xml. A diferencia de Googlebot, no ejecuta JavaScript: solo procesa el HTML en estado bruto. Si el contenido depende de renderizado del lado del cliente, será invisible para el bot.²

Indexación (Indexing): GPTBot construye un índice interno de recuperación de fragmentos de texto y metadatos, distinto de un índice de búsqueda tradicional. Un contenido bien estructurado y rastreable tiene mayor probabilidad de ser almacenado en un formato que el modelo pueda citar con precisión.²

¿Por qué es necesario optimizar un sitio para bots de IA además de Googlebot?

Aunque existe intersección entre SEO tradicional y optimización para bots de IA, no son equivalentes. Un sitio técnicamente optimizado para Google puede no estar preparado para modelos de lenguaje si depende excesivamente de JavaScript o carece de estructura semántica clara.

Además, las plataformas de IA emergentes están cobrando cada vez más relevancia en el ecosistema de rastreo. Googlebot sigue siendo el más dominante, pero los bots generativos están ganando cuota rápidamente: Meta-ExternalAgent, por ejemplo, registró un incremento relativo del 36 % en solo 30 días.¹

La tabla a continuación muestra cada bot y su cuota actual en el tráfico de rastreo de IA:¹

Bot de IA | Cuota enero 2026 (%) | Operador | Propósito principal |

Googlebot | 38,7% | Indexación de búsqueda y entrenamiento de IA (mixto) | |

GPTbot | 12,8% | OpenAI | Entrenamiento de modelos |

Meta-ExternalAgent | 11,6% | Meta | Entrenamiento de IA |

Claudebot | 11,4% | Anthropic | Entrenamiento de modelos |

Bingbot | 9,7% | Microsoft | Indexación de búsqueda + IA (mixto) |

Amazonbot | 4,8% | Amazon | Entrenamiento de IA |

Bytespider | 3,5% | ByteDance | Entrenamiento de IA |

Applebot | 2,5% | Apple | Búsqueda + funcionalidades de IA |

OAI-SearchBot | 2,0% | OpenAI | Búsqueda en ChatGPT |

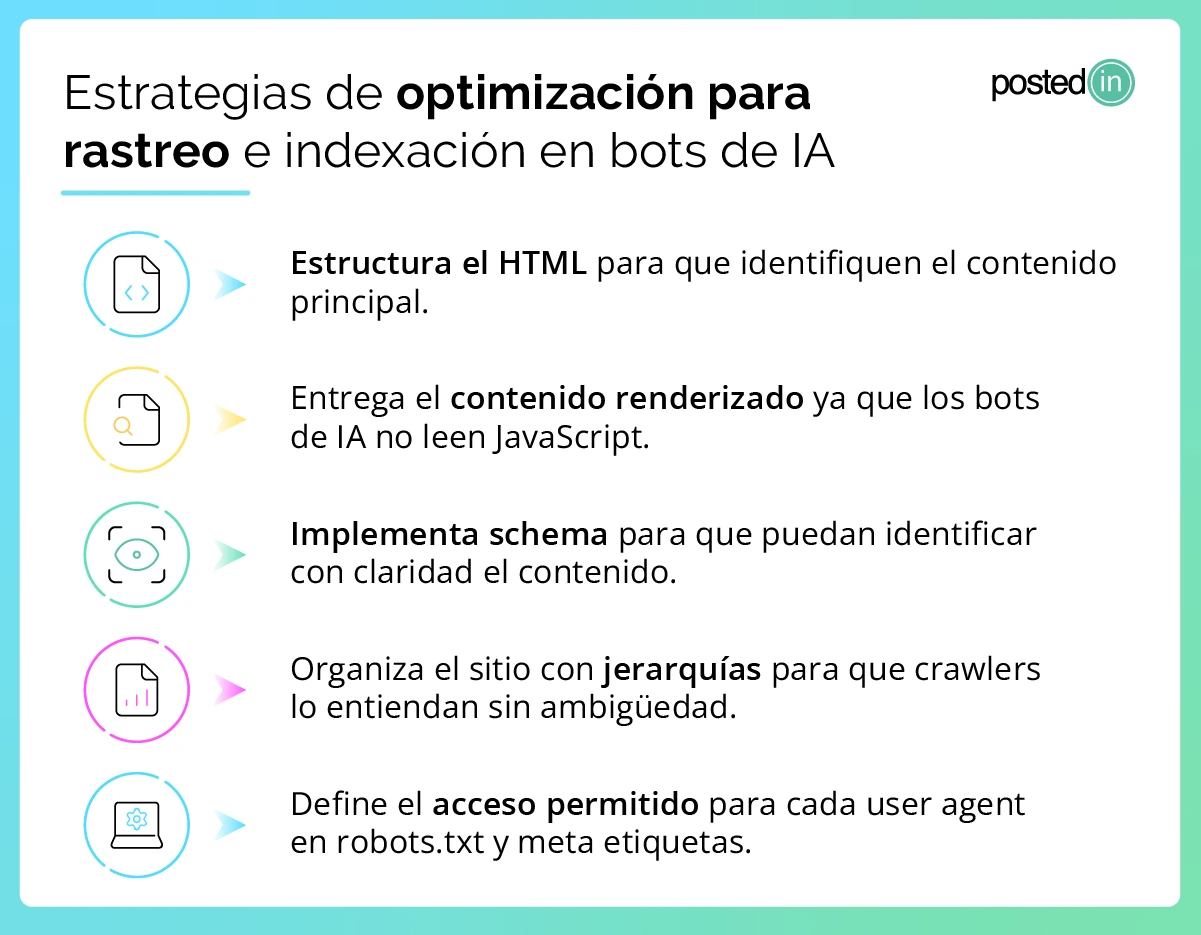

Estrategias de optimización para rastreo e indexación en plataformas generativas

La optimización para rastreadores amplía el SEO con criterios específicos de interpretabilidad para LLMs. Estas son estrategias técnicas fundamentales para garantizar que los bots de inteligencia artificial puedan rastrear, indexar y recuperar el contenido correctamente.

1. HTML limpio y accesible

El HTML es la única capa que los bots de IA puros procesan. Si está mal estructurado, el agente no puede identificar qué es contenido principal y qué es decoración.

La estrategia es revisar el HTML para que el contenido esté disponible desde el primer acceso, sin capas adicionales de presentación.

Utiliza etiquetas semánticas ("article", "section" y "main") para que el bot identifique el contenido principal.

Elimina divs anidados innecesarios para que el crawler pueda leer la página sin obstáculos.

Verifica que el texto clave no esté dentro de atributos HTML que los bots no leen.

2. Renderizado del lado del servidor

El bot de IA no ejecuta JavaScript, por lo que el renderizado del lado del servidor se vuelve determinante. El posicionamiento en IA tenderá a favorecer arquitecturas SSR, SSG o ISR frente a CSR puro.

En este caso, se debe asegurar que el contenido principal se entregue completamente renderizado al momento de la solicitud HTTP.

Aplica SSR en páginas con contenido clave para que el bot reciba el texto desde el primer request.

Usa SSG en páginas estáticas y verifica con curl que el HTML ya contiene el contenido.

No coloques contenido importante en componentes que solo cargan después de ejecutar JavaScript.

3. Datos estructurados consistentes

El schema markup le da contexto semántico al contenido. Los LLMs priorizan páginas donde pueden identificar con claridad el tipo de contenido, el autor y la fecha.

La implementación de datos estructurados permite agrupar los metadatos de forma centralizada, lo que facilita su mantenimiento y validación sin intervenir el HTML de presentación.

Implementa JSON-LD usando el tipo que corresponda a cada página, como BlogPosting, Product o FAQPage.

Utiliza validadores para comprobar que el schema sea correcto antes de publicar.

Asegúrate de que los datos del schema coincidan con el contenido visible en la página.

4. Arquitectura clara y jerárquica

Los crawlers de IA infieren jerarquías temáticas a partir de URLs, encabezados y enlaces internos. Sin coherencia arquitectónica, generan señales ambiguas que afectan la indexación.

Se debe organizar el sitio para que tanto los crawlers como los usuarios entiendan de qué trata cada sección y cómo se relaciona con el resto.

Utiliza URLs jerárquicas para que la estructura sea legible para los bots.

Aplica etiquetas H de forma coherente para que cada nivel marque un bloque temático distinto.

Conecta páginas relacionadas con enlaces internos para facilitar la navegación de los crawlers.

5. Control de rastreo e indexación

Cada bot de IA opera con un user-agent distinto y puede controlarse de forma independiente en el robots.txt. La meta etiqueta robots permite un control adicional a nivel de página.

Por lo que se debe definir explícitamente qué rastreadores pueden acceder a partes específicas del sitio y complementarlo con instrucciones por página para controlar qué contenido puede ser indexado o citado.

Define reglas en el archivo de rastreo (robots.txt) para controlar el contenido al que accede cada bot.

Agrega la etiqueta de no indexación en páginas que deban excluirse de los resultados de IA.

No combines Disallow con noindex en la misma página: si el bot no entra, no lee la directiva.

Optimiza tu sitio corporativo para que la IA lo encuentre fácilmente

La visibilidad digital ya no se define solo por el ranking en Google. En el ámbito de IA bots, indexación web y recuperación de contenido, las reglas están cambiando, y los sitios que no adapten su arquitectura técnica a estas condiciones quedarán fuera del ecosistema de respuestas generadas por IA.

En Postedin ejecutamos estrategias SEO, GEO y AEO con foco en los aspectos técnicos de la IA, diseñando cada acción en función de cómo operan los bots para potenciar la visibilidad de tu marca en entornos generativos.

Referencia:

Monthly AI Crawler Report: January 2026 Traffic Trends - WebsearchAPI

How OpenAI Crawls and Indexes Your Website - Daydream

Preguntas frecuentes sobre bots de IA y Googlebots

¿Qué es un bot de IA y en qué se diferencia de Googlebot?

Los bots de inteligencia artificial son agentes automatizados que rastrea contenido para entrenar modelos o alimentar sistemas generativos. A diferencia de Googlebot, no construyen un índice de búsqueda tradicional, no renderizan JavaScript y su propósito es sintetizar información, no posicionar páginas.

¿Cómo leen los bots de IA el contenido web?

En el ámbito de IA bots, indexación web funciona de forma distinta a la búsqueda tradicional. Estos agentes procesan únicamente el HTML en estado bruto que reciben del servidor, sin ejecutar JavaScript, por lo que cualquier contenido renderizado del lado del cliente es invisible para ellos.

¿Cuáles son las estrategias clave para la indexación y el rastreo por bots de IA?

La optimización para bots de IA requiere HTML limpio y semánticamente correcto, server-side rendering, datos estructurados con schema markup, arquitectura jerárquica clara y control granular del rastreo mediante robots.txt y meta etiquetas.

¿Cómo considera Postedin el rastreo y la indexación en sus estrategias SEO?

En Postedin ejecutamos estrategias SEO, GEO y AEO con foco en la indexación para IA y los motores de búsqueda con IA, diseñando cada acción en función de cómo operan los bots para potenciar la visibilidad de tu marca.